英特尔酷睿 Ultra 处理器引入了独立的 NPU(神经处理单元),让个人电脑本地运行 AI 大模型成为可能。有人用它搭建了一个类似「贾维斯」的 AI 语音助手 — 查天气、抓热榜、打开文件,全部在本地完成。这是 AI 从云端走向个人设备的一个缩影。对于内容创作者来说,AI 工具正在从各个维度提升生产力 — 无论是本地语音助手还是云端视频制作。

快速结论

酷睿 Ultra 的 NPU 让本地 AI 推理成为现实,隐私保障和离线能力是最大优势。但目前仍处于「极客玩具」阶段 — 缺乏开箱即用的消费级应用,需要编程基础才能搭建。对于大多数内容创作者而言,成熟的云端 AI 工具(如 Fliki 的 AI 视频制作)依然是当前最高效的选择。

硬件参数

| 参数 | 数值 | 备注 |

|---|---|---|

| 处理器 | 酷睿 Ultra 5 125H | 主流入门级 AI PC |

| 运行模型 | ChatGLM3 (6B 参数) | 4bit 量化,内存占用 < 4GB |

| 硬件架构 | GPU + NPU | GPU 高性能计算 / NPU 低功耗长效任务 |

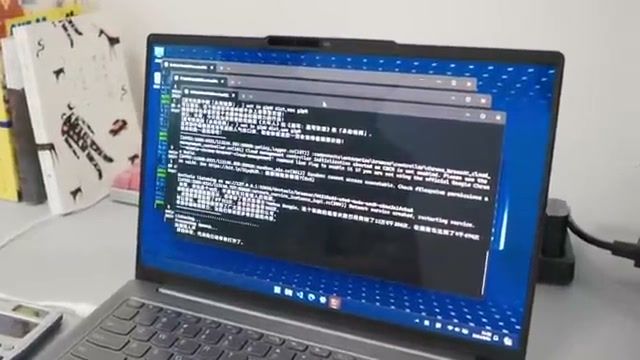

| 开发环境 | OneAPI / OpenVINO | 衔接底层硬件与 AI 框架 |

实测体验

本地大模型运行

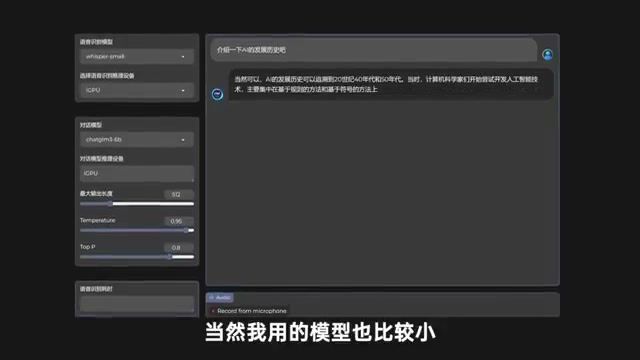

通过英特尔的 BigDL 库,可以在酷睿 Ultra 上运行 ChatGLM3(60 亿参数模型)。4bit 量化版本占用内存不到 4GB,在入门级芯片上也能流畅推理。

虽然和 GPT-4 这样的顶级云端模型还有差距,但对于日常对话和简单任务来说完全够用 — 关键是所有数据都在本地处理,完全不需要联网。

AI 语音助手交互

搭建的 AI 助手「云若」可以通过语音进行自然语言交互。实测中,它能理解复杂语境,响应速度也令人满意。比传统语音助手(如 Siri、小爱同学)更灵活,不会出现机械式的逻辑错误。

自动化信息获取

通过 Selenium 自动化工具,AI 助手可以实时抓取知乎热榜、B 站热门等互联网信息,并用自然语言进行总结汇报。

这个功能对内容创作者来说很有启发 — 想象一下,AI 自动帮你搜集热门话题,然后你用 Fliki 快速将话题做成短视频,整个从选题到出片的流程可以大幅缩短。

控制本地系统

AI 助手还能执行本地系统指令 — 比如打开代码编辑器、启动特定程序。虽然目前这些功能还比较初级,但展示了 AI PC 在日常办公自动化方面的巨大潜力。

需要注意的现实

- 门槛高:需要编程基础才能搭建,普通用户无法直接使用

- 应用不成熟:目前缺乏开箱即用的消费级 AI 应用

- 性能有限:60 亿参数模型与顶级云端模型仍有差距

- 自动化不稳定:Selenium 等工具依赖网页结构,存在不稳定性

- 仅限极客:这是一个「能跑起来」的 Demo,离「好用」还有距离

本地 AI vs 云端 AI:内容创作者怎么选?

对于内容创作者来说,AI 工具的核心价值是提升产出效率。目前两种路径各有优劣:

| 对比项 | 本地 AI (AI PC) | 云端 AI (如 Fliki) |

|---|---|---|

| 成熟度 | 早期阶段,需要自行搭建 | 成熟产品,注册即用 |

| 上手门槛 | 高(需编程基础) | 低(浏览器操作) |

| 隐私 | 极高(数据不离开电脑) | 高(依赖平台安全性) |

| 功能 | 通用 AI 助手 | 专注视频/音频制作 |

| 产出效率 | 低(目前还是实验阶段) | 高(3-5 分钟出片) |

| 成本 | 硬件投资 | 免费起 / $21/月 |

现阶段的务实建议:关注本地 AI 的发展趋势,但用成熟的云端工具完成实际工作。等到本地 AI 应用生态成熟后,两者结合使用会是最理想的状态 — 比如本地 AI 助手帮你选题和写脚本,Fliki 帮你将脚本快速转化为视频。

适合谁?

AI PC 本地部署适合:

- 极客和开发者 — 抢先体验本地大模型

- 隐私极度敏感的用户 — 数据完全不离开电脑

- 早期采用者 — 愿意为未来技术投入时间和硬件

云端 AI 工具适合:

- 需要现在就提升产出效率的内容创作者

- 不想折腾部署的普通用户

- 需要专业级 AI 视频制作和配音的团队

本文基于 2026 年 3 月的实测数据撰写。AI PC 生态正在快速发展,硬件和软件能力可能随时更新。